Beyond the Chatbot: Wie das Model Context Protocol (MCP) Ihre Datensilos aufbricht

Künstliche Intelligenz beherrscht die Kunst der Konversation, scheitert jedoch häufig an spezifischen Anforderungen Ihrer Geschäftsprozesse. Das Model Context Protocol (MCP) ist das fehlende Bindeglied: Es verwandelt generische LLMs in spezialisierte Agenten, die echte Arbeit leisten können.

Die Art und Weise, wie wir Informationen abrufen, hat sich zwischen 1998 und 2023 kaum verändert: Wir haben Schlüsselwörter in eine Suchleiste getippt und Links durchsucht. Dann kam ChatGPT, und plötzlich erwartete die Welt sofortige, zusammengefasste Antworten.

Für Unternehmen bleibt jedoch eine kritische Lücke. Während Large Language Models (LLMs) über umfangreiches „Weltwissen“ verfügen, sind sie blind für Ihre privaten Daten. Sie kennen weder die Sendungsnummer Ihrer Kunden noch die Struktur interner Wikis oder aktuelle Lagerbestände. Um diese Lücke zu schließen, haben Unternehmen teure und fragile Integrationen aufgebaut.

Das wird sich nun ändern. Ein neuer Standard, das Model Context Protocol (MCP), entwickelt sich zum „USB-C für KI“. Es verspricht zu standardisieren, wie KI-Agenten auf Ihre Daten zugreifen.

Die Herausforderung: Das Spaghetti-Code-Problem

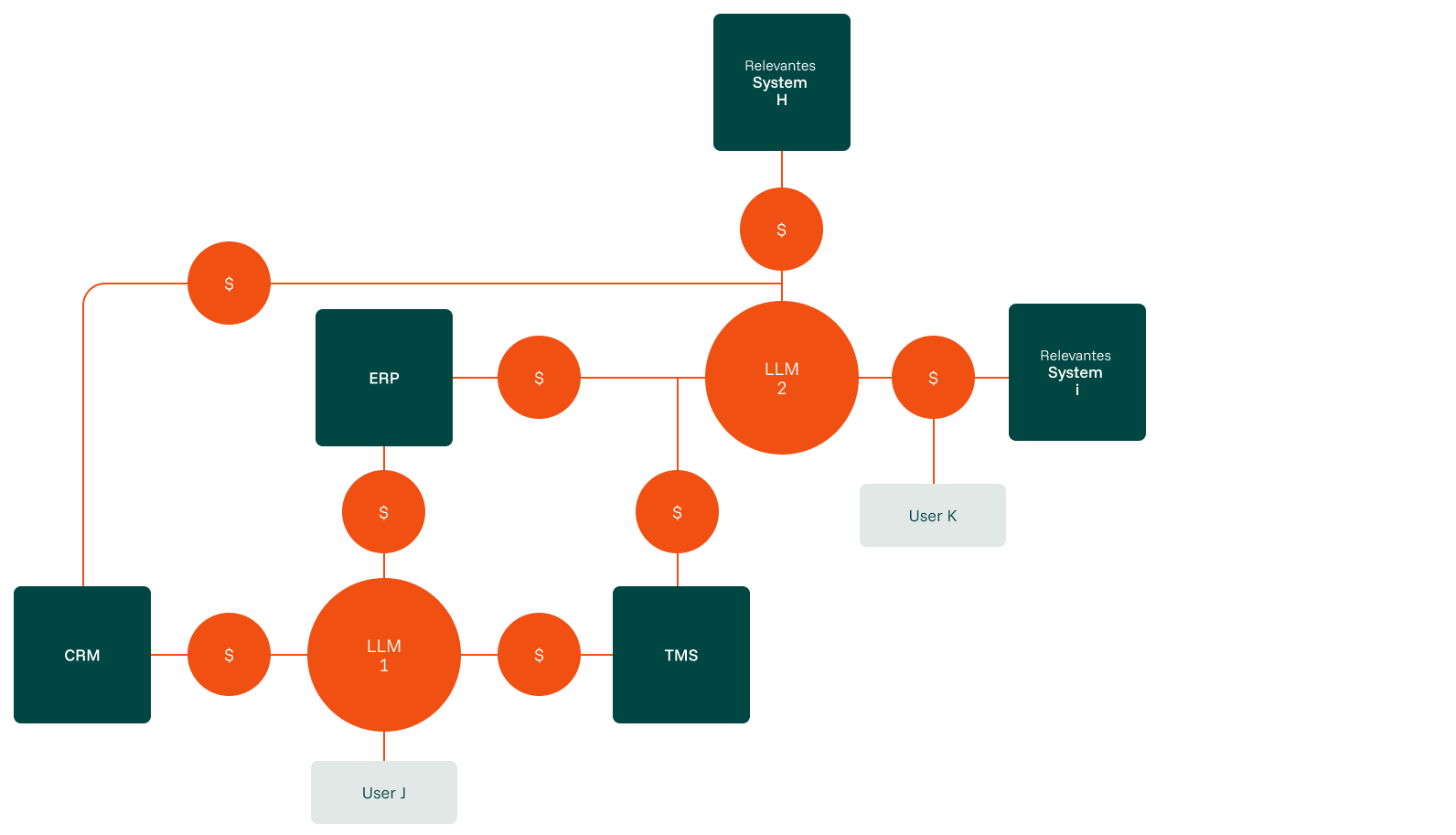

Derzeit ist die Anbindung eines LLM an proprietäre Daten eine maßgeschneiderte Engineering-Aufgabe. Wenn Ihre KI auf ein CRM, ein Kundensupportsystem und ein ERP zugreifen soll, muss für jedes System eine teure, individuelle Pipeline entwickelt werden.

Das Problem verschärft sich exponentiell. Wenn Sie morgen ein anderes KI-Modell einsetzen (z. B. Wechsel von GPT-4 zu Claude) oder ein neues internes Tool hinzufügen, muss diese Verbindungen neu aufgebaut werden. Dadurch entsteht eine sogenannte Spaghetti-Architektur, bei der Kosten und Komplexität mit jedem neuen Anwendungsfall überproportional wachsen.

Diese Reibung ist der Grund, warum viele KI-Piloten auch Pilotprojekte bleiben. Sie sind schlicht zu teuer in Wartung und Skalierung.

Die Lösung: Das USB-C für KI

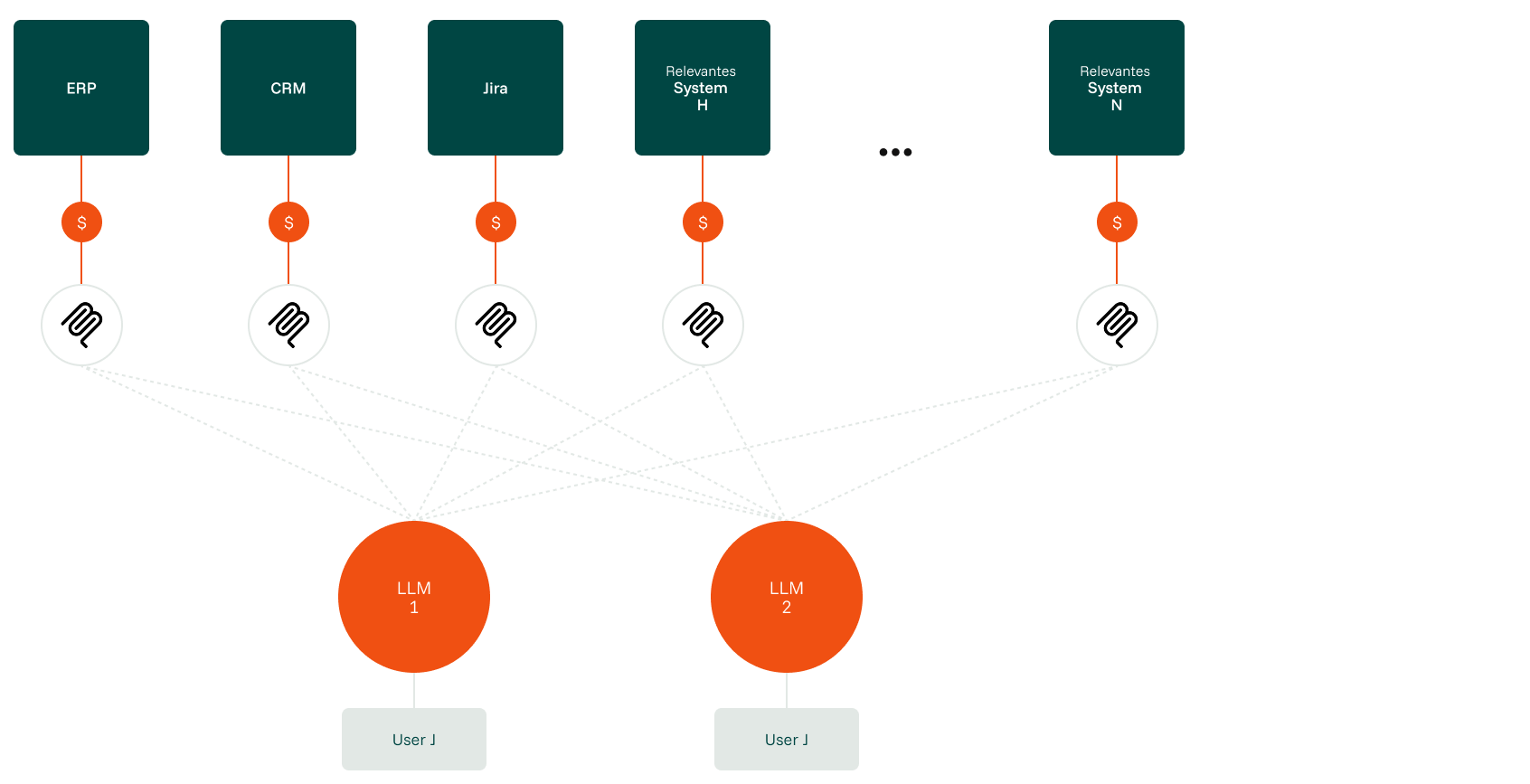

Stellen Sie sich MCP als universellen Adapter vor. Anstatt eine feste Verbindung zwischen einer bestimmten KI und einem bestimmten Service zu programmieren, bauen Sie einen MCP-Server.

Dieser Server fungiert als standardisierter Host, der jedem KI-Client mitteilt: „Hier sind die Ressourcen, die ich habe (Daten), und hier sind die Werkzeuge, die ich nutzen kann (Funktionen).“

-

Plug & Play: Sobald Sie Ihre Daten über MCP bereitstellen, spielt der verwendete LLM-Client keine Rolle mehr . Sie bauen die Verbindung einmal – und sie funktioniert überall.

-

Bidirektionaler Zugriff: Die KI kann Daten nicht nur „lesen“ (wie ein Dokument), sondern auch darauf „handeln“ – etwa Datenbankabfragen oder API-Aufrufe sicher auslösen.

Dadurch verschiebt sich die Integrationskomplexität von exponentiellem zu linearem Wachstum. Sie bauen nicht mehr für jedes Projekt eine neue Pipeline, sondern eine wiederverwendbare Utility-Schicht für Ihr gesamtes Unternehmen.

Von Chatbots zu Agenten: Der geschäftliche Mehrwert

Warum ist das für Entscheidungsträger relevant? Weil es KI-Agenten radikal vereinfacht – Systeme, die autonom wahrnehmen, entscheiden und handeln können.

1. Revolutionierung der Customer Experience (B2C oder B2B)

Betrachten wir ein Szenario im Bereich Live-Broadcast-Operations. Wenn ein Produktionsleiter fragt: „Wie ist der Status des heutigen Fußballspiel-Feeds?“, kann ein Standard-LLM nur halluzinieren oder generische Antworten geben. Ein MCP-fähiger Agent hingegen verbindet sich direkt mit dem Playout-System, der Rechte-Datenbank und dem Dispositions-Tool über MCP-Server.

Er identifiziert den konkreten Feed, prüft den Satellitenstatus („Uplink bestätigt, Backup-Glasfaserverbindung ausstehend“), gleicht dies mit Rechtefreigaben für alle Territorien ab und erkennt, dass die Lizenz für Dänemark um Mitternacht ausläuft. Der Produktionsleiter erhält eine konsolidierte Antwort, anstatt drei Systeme einzeln prüfen zu müssen.

Er identifiziert die konkrete Sendungsnummer, fragt den Live-Status ab („Ausnahme: Festhängend in Köln-West“), kann gegebenenfalls automatisch den 2nd/3rd-Level-Support auslösen und informiert den Kunden sofort.

2. Stärkung der Mitarbeitenden (intern)

Intern verwandelt MCP Wissensmanagement in einen aktiven Assistenten. Stellen Sie sich vor, ein Mitarbeiter fragt nach allen verfügbaren Informationen zu einem internen Thema.

Die KI kann frühere Nachrichten im firmeninternen Chat-System durchsuchen, diese mit Dokumentationsseiten im Wiki abgleichen und alle Ergebnisse autonom auswerten, um die Suche weiter zu verfeinern – und so zwei völlig unterschiedliche Softwaresilos nahtlos verbinden.

Wo anfangen: Low-Hanging Fruits identifizieren

Die Implementierung von MCP ist ein architektonischer Wandel, aber Sie müssen Ihre gesamte IT-Landschaft nicht sofort umstellen. Wir empfehlen, mit Prozessen zu beginnen, die auf der Automatisierbarkeitsskala hoch bewertet werden:

Suchen Sie nach Aufgaben, die Ihr Team täglich erledigt und bei denen Daten manuell zwischen Systemen übertragen werden.

MCP funktioniert besonders gut mit strukturierten Daten (Datenbanken, Tabellen) und weniger mit unstrukturierten Daten (chaotische PDFs).

Beginnen Sie mit internen Tools oder Read-only-Szenarien, um Risiken zu minimieren und den ROI zu belegen.

Vermeiden Sie in frühen Pilotprojekten Prozesse mit personenbezogenen Daten oder geistigem Eigentum. Falls sensible Daten involviert sind, können MCP-Server strikte Zugriffskontrollen durchsetzen – am einfachsten ist jedoch ein Start ohne Compliance-Hürden.

Fazit: Das Ende statischer KI

Die Ära statischer, textbasierter KI geht zu Ende. Wir treten in das Zeitalter vernetzter KI-Agenten ein, die direkt mit Ihren Daten arbeiten.

Während Bespoke-RAG-Systeme (Retrieval-Augmented Generation) nicht verschwinden, gehört die Zukunft standardisierten Protokollen, die die Kosten von Neugier senken. Mit der Einführung von MCP bauen Sie nicht nur einen Chatbot – Sie bereiten Ihre APIs auf eine Zukunft vor, in der Ihre Software mit sich selbst kommuniziert und Ihre Mitarbeitenden sich auf ihre Kernkompetenzen konzentrieren können.